Los clientes están mostrando un creciente interés en el uso de grandes modelos de lenguaje (LLMs) para abordar problemas prácticos, pero conectar estos modelos con aplicaciones reales ha sido un desafío notable. En este panorama, los agentes de inteligencia artificial emergen como una solución prometedora para cerrar esta brecha.

Amazon Bedrock, con sus modelos de base (FMs), actúa como el motor cognitivo que permite a estos agentes comprender el lenguaje natural y responder adecuadamente a las solicitudes de los usuarios. Estos modelos se pueden integrar con diversas plataformas de orquestación y marcos de agentes para desarrollar aplicaciones de IA que interpreten el contexto, tomen decisiones y ejecuten acciones. Por ejemplo, se pueden crear aplicaciones utilizando Amazon Bedrock Agents, LangGraph y el recientemente lanzado Strands Agent SDK.

Para los equipos que desean optimizar sus flujos de trabajo en GitHub, Amazon Q Developer en GitHub proporciona una integración nativa que facilita la generación, revisión y transformación de código sin necesidad de desarrollar agentes personalizados. Esta herramienta ofrece una solución estándar para flujos de trabajo comunes, mientras que las organizaciones con necesidades específicas pueden crear soluciones personalizadas utilizando Amazon Bedrock y otros marcos de agentes. Esta flexibilidad les permite a los equipos elegir entre una solución prediseñada o un enfoque más específico basado en sus requerimientos y el nivel de control deseado sobre la implementación.

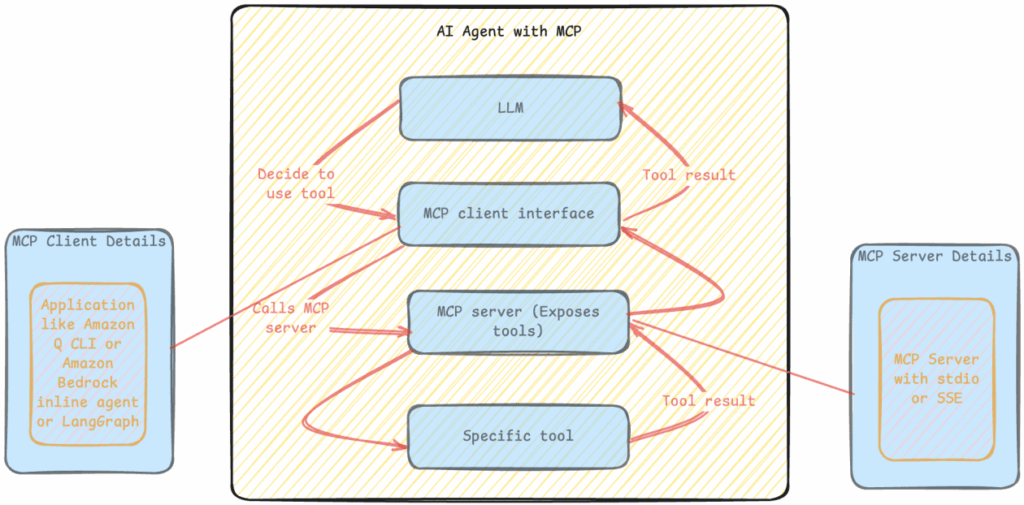

A pesar de los avances en la tecnología de agentes de IA, la integración de herramientas sigue siendo un gran desafío. Aunque existen marcos como Amazon Bedrock Agents y el Strands Agent SDK, la falta de estandarización y flexibilidad en estos enfoques ha supuesto una barrera. El Protocolo de Contexto del Modelo (MCP) surge como una solución innovadora. MCP estandariza la integración de herramientas, simplificando así la creación de integraciones y permitiendo el uso de patrones más sofisticados, como el encadenamiento de herramientas.

La combinación de tecnologías como los FMs de Amazon Bedrock, las capacidades de gestión de contexto del MCP y el marco de LangGraph, permite la creación de agentes capaces de realizar tareas complejas con mayor eficiencia. Esto se traduce en flujos de trabajo más automatizados en entornos como GitHub, donde las tareas rutinarias podrían ser resueltas de manera autónoma durante la noche.

La reciente evolución de los LLMs, particularmente aquellos con capacidad para generar código, promete transformar los flujos de trabajo de desarrollo. A través de los agentes, los equipos pueden automatizar actualizaciones y correcciones, mejorando significativamente la eficiencia.

Amazon Bedrock ofrece un servicio gestionado que brinda acceso a modelos de alto rendimiento mediante una API unificada, combinando capacidades de IA generativa con seguridad y responsabilidad. LangGraph, por su parte, orquesta flujos de trabajo mediante una arquitectura de grafos que mantiene el contexto de las interacciones.

El MCP fomenta conexiones seguras y bidireccionales entre fuentes de datos y herramientas impulsadas por IA, facilitando la automatización y el análisis de código. La integración con GitHub permite a los desarrolladores mejorar sus procesos de manera eficiente.

La implementación de este sistema automatizado busca no solo mejorar la productividad, sino también transformarla, abordando las actuales limitaciones de los agentes de IA. Con una colaboración armónica entre IA y desarrolladores humanos, el futuro de la automatización en el desarrollo ofrece nuevas oportunidades si se gestionan adecuadamente los desafíos actuales.