La creciente demanda de servicios de inteligencia artificial generativa ha puesto en el centro de atención la necesidad de gestionar eficientemente los costos asociados a la escalabilidad y operación de estos sistemas. En este contexto, la multinacional Amazon ha desarrollado una propuesta innovadora para su plataforma Amazon Bedrock, que optimiza los costos en entornos de múltiples inquilinos mediante el uso de perfiles de inferencia de aplicación.

El reto principal al que se enfrentan las empresas que implementan sistemas de inteligencia artificial generativa como servicio es equilibrar la escalabilidad del servicio con una gestión de costos efectiva. Los tradicionales métodos de administración financiera a menudo resultan ineficaces para manejar el uso variado de diferentes clientes. Algunos experimentan picos repentinos en la demanda, mientras que otros mantienen un uso más uniforme, complicando la atribución precisa de costos.

Para superar estas dificultades, Amazon ha introducido un sistema de alertas dinámico y por niveles. Este sistema, que va desde el verde (operaciones normales) hasta el rojo (intervenciones críticas), permite una monitorización más inteligente y proactiva de los patrones de uso, anticipándose a posibles sobrecostos y mejorando la asignación de recursos.

Los picos inesperados en el uso de los servicios suelen provocar un incremento significativo en los costos, un problema exacerbado por el empleo de modelos de precios escalonados. Estos modelos, que ajustan el precio según el consumo y los compromisos, pueden llevar a que los sistemas convencionales de alertas, caracterizados por su simplicidad, sean inadecuados. Las notificaciones binarias no ofrecen el nivel de detalle necesario para diferenciar entre fluctuaciones normales y problemas reales, llevando a respuestas reactivas en lugar de proactivas por parte de los equipos de operaciones.

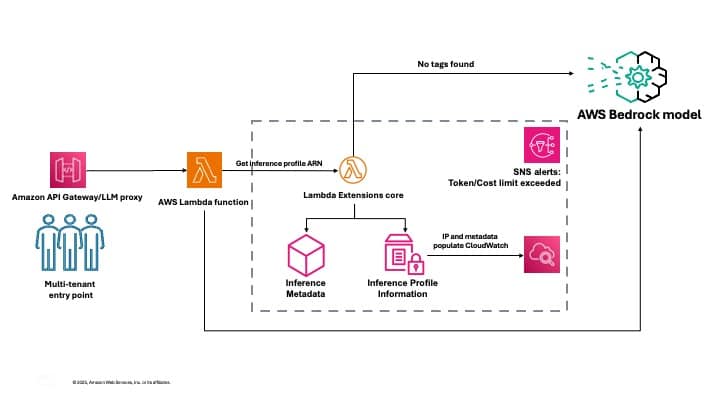

El enfoque propuesto por Amazon utiliza perfiles de inferencia para vigilar el consumo de recursos con gran detalle. Asociando metadatos a cada solicitud de inferencia, se logra una separación lógica entre los diferentes clientes que utilizan los modelos. Esta estrategia de etiquetado coherente permite a Amazon rastrear qué inquilino incurre en cada costo, facilitando la gestión de acuerdo a las necesidades de cada caso.

La arquitectura de esta solución no solo permite monitorear de manera efectiva y almacenar métricas históricas, sino que también proporciona herramientas de análisis de tendencias y paneles intuitivos que facilitan decisiones informadas. Al implementar esta arquitectura, las empresas no solo pueden prever y mitigar sobrecostos, sino también ajustar sus estrategias basadas en datos fiables y análisis detallados.

En última instancia, esta solución permite no solo rastrear con precisión el uso de modelos y asignar costos, sino también optimizar el consumo de recursos entre diferentes inquilinos. Mediante el continuo ajuste de la infraestructura basándose en los patrones de uso observados, las organizaciones pueden lograr una gestión más eficiente y efectiva de sus recursos en el ámbito de la inteligencia artificial generativa.