En una publicación reciente, se exploró la implementación de incrustaciones de lenguaje en una aplicación de agregador de RSS, mejorando significativamente su funcionalidad mediante Amazon Bedrock. Este servicio completamente gestionado ofrece acceso a modelos fundamentales de inteligencia artificial, permitiendo la personalización y eventual integración en diversas aplicaciones.

La aplicación de agregador utiliza el modelo Cohere v3 Embed para generar incrustaciones de lenguaje, facilitando así la clasificación «zero-shot» y una búsqueda semántica avanzada. Los usuarios pueden suscribirse a fuentes RSS y recibir listas categorizadas de artículos, que son clasificados automáticamente en temáticas como Tecnología, Política, y Salud, además de tener la capacidad de crear temas personalizados.

La clasificación «zero-shot» permite etiquetar artículos en diversas categorías sin necesidad de un entrenamiento previo específico para cada clase. Esta técnica utiliza las incrustaciones de los artículos para encontrar similitudes con categorías predefinidas, asignando etiquetas mediante el algoritmo k-NN. La búsqueda semántica, por otro lado, se enfoca en buscar artículos no solo por palabras clave, sino también considerando el tono y el estilo, gracias a la representación semántica en un espacio de incrustación.

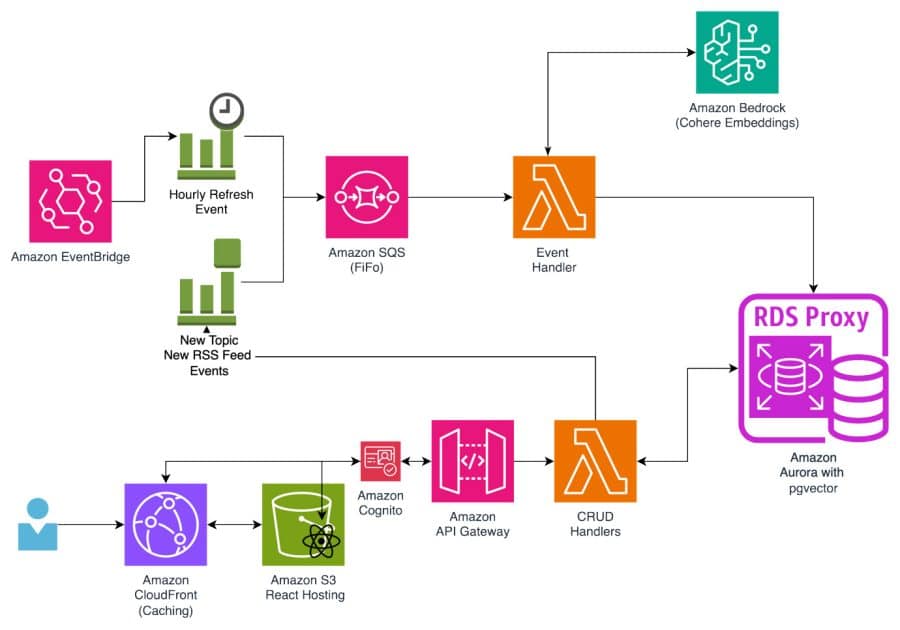

La arquitectura de la aplicación incluye varios servicios de Amazon, como Amazon API Gateway, CloudFront, y Cognito para la autenticación, y utiliza Amazon Aurora como base de datos. Aurora incorpora la extensión pgvector, que permite realizar búsquedas de similitud basadas en vectores.

Esta innovación no solo mejora la experiencia del usuario al facilitar la búsqueda y clasificación de información, sino que también destaca el potencial de las incrustaciones de lenguaje para transformar la manera en que interactuamos con contenidos digitales, ofreciendo resultados más relevantes y personalizados.